الأخلاقيات والقوانين الدولية: تشكيل مستقبل الذكاء

الأخلاقيات والقوانين الدولية: تشكيل مستقبل الذكاء

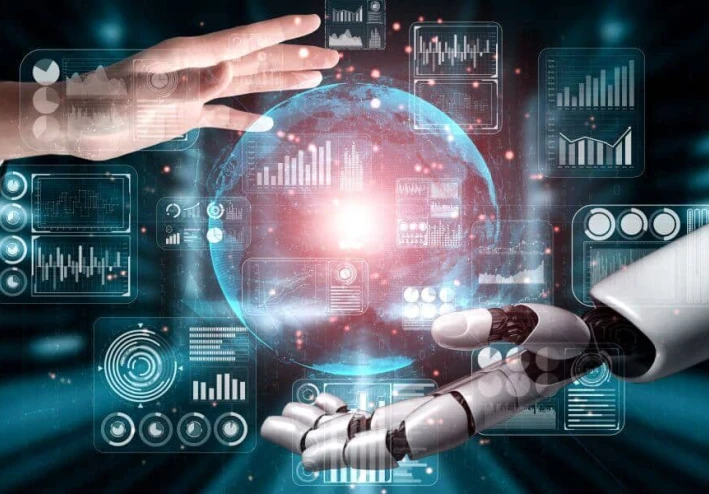

في عصر تتسارع فيه خُطى الذكاء الاصطناعي ليصل إلى كل زاوية من حياتنا، من تشخيص الأمراض إلى قرارات المحاكم، لم يعد السؤال هو "ماذا يمكن للتقنية أن تفعل؟"، بل أصبح: "ما الذي ينبغي أن يُسمح لها بأن تفعله؟".

ومع تحوّل الذكاء الاصطناعي إلى فاعل رئيسي في مستقبل البشرية، تبدأ معركة من نوع آخر: معركة الأخلاق والقانون الدولي.

---

⚖️ من يصنع القواعد… ومن يلتزم بها؟

الذكاء الاصطناعي لا يعرف الخير والشر، ولا يفرّق بين العدالة والانحياز. إنه يعكس البيانات التي يتغذى بها، والتي كثيرًا ما تكون مشبعة بالتحيزات الثقافية أو العرقية أو الاقتصادية. وهذا ما يطرح تحديًا جوهريًا: من يضع المعايير الأخلاقية لهذه النظم؟

فهل يُترك الأمر لشركات التكنولوجيا العملاقة؟ أم يُنظم من خلال الحكومات؟ أم يحتاج إلى إطار عالمي شبيه باتفاقية جنيف لحقوق الإنسان؟

حتى الآن، لا يوجد ميثاق أخلاقي موحد عالميًا. أوروبا أطلقت "قانون الذكاء الاصطناعي"، والولايات المتحدة طوّرت مبادئ إرشادية، لكن دولًا أخرى لا تزال في طور المراقبة أو حتى الاستغلال غير الأخلاقي.

---

🤖 حالات واقعية تُفجّر الجدل

في الصين، يُستخدم الذكاء الاصطناعي في أنظمة المراقبة لتتبع الأفراد وتقييم سلوكهم "اجتماعيًا".

في الولايات المتحدة، واجهت أنظمة التوظيف التي تعمل بالذكاء الاصطناعي اتهامات بانحيازها ضد النساء والأقليات.

في إسرائيل، كشف تقرير حديث عن استخدام الذكاء الاصطناعي في توجيه ضربات عسكرية بشكل شبه مستقل، ما أثار غضب المنظمات الحقوقية.

كل هذه الأمثلة تُظهر أن الذكاء الاصطناعي يمكن أن يتحوّل من "مساعد ذكي" إلى أداة قمع أو تمييز أو حتى قتل إذا غابت الضوابط الأخلاقية والقانونية.

---

🌍 الحاجة إلى اتفاقية عالمية

كما وُضعت اتفاقيات تنظم استخدام الأسلحة النووية، وأخرى تُعنى بحقوق الطفل واللاجئين، بات العالم بحاجة ماسة إلى "اتفاقية دولية لتنظيم الذكاء الاصطناعي"، تشمل:

1. الشفافية في كيفية عمل الأنظمة واتخاذها للقرارات.

2. المساءلة القانونية عند وقوع أضرار بسبب أنظمة الذكاء الاصطناعي.

3. منع الاستخدام العسكري أو القمعي للذكاء في مجالات تهدد الكرامة الإنسانية.

4. حماية البيانات الشخصية والهوية الرقمية.

5. عدالة الوصول للتقنيات بين دول الشمال والجنوب.

وقد دعت منظمات مثل الأمم المتحدة واليونسكو إلى وضع مثل هذا الإطار، لكن التنفيذ لا يزال بطيئًا ومترددًا في ظل تضارب مصالح الدول والشركات.

---

🧠 هل يمكن تعليم الأخلاق للآلة؟

محاولات "برمجة الأخلاق" داخل أنظمة الذكاء الاصطناعي ما زالت في مراحلها الأولى. بعض الباحثين يعملون على إدخال ما يسمى "قيم عالمية" داخل خوارزميات الذكاء، لكن هل يمكن للآلة أن تفهم المعاناة؟ أو تُقدّر الحياة؟ أو تزن الأولويات كما يفعل الإنسان؟

من هنا، تبرز خطورة ترك الأمور بالكامل للذكاء الاصطناعي دون رقابة بشرية واضحة، حيث لا يكفي الاعتماد على التكنولوجيا وحدها لصنع قرارات أخلاقية.

---

📌 الختام: سباق غير متكافئ

في سباق التقنية، تتقدم البرمجة بسرعة الضوء، بينما تزحف القوانين كسلحفاة. الفجوة بين ما يستطيع الذكاء الاصطناعي فعله، وما ينبغي أن يُسمح له بفعله، تتسع بشكل مرعب.

العالم بحاجة إلى أن يتوحّد، لا لوقف الابتكار، بل لضمان أن يكون الابتكار في خدمة العدالة، والكرامة، والإنسانية.

فمستقبل الذكاء الاصطناعي لا يُحدده المطوّرون فقط... بل يُصاغ الآن بين سطور القوانين، وفي ضمير المجتمعات.

---