هل تم تسريب محادثات ChatGPT التي تمت مشاركتها.

تضج المواقع حول العالم بالكثير من الافتراضات والتحليلات, فدعونا نشارك ونحاول تقديم أقرب صورة.

في عام 2023, تسبب خطأ في إحدى مكتبات التشفير لدى OpenAI في تبادل المحادثات بين المستخدمين, حيث تفتح الموقع فتجد سجل دردشات لشخص آخر.

تعاملت OpenAI مع الخطأ بسرعة وانتهى الأمر.

والآن, الشركة على موعد مع مشكلة أضخم.

توفر لك معظم خدمات الذكاء الاصطناعي ميزة لمشاركة محادثتك مع شخص آخر, وذلك عن طريق عمل مشاركة من موقع الخدمة, ChatGPT في حالتنا, أو من خلال التطبيق.

عند عمل مشاركة يتم إنشاء رابط للمحادثة حتى وقت المشاركة, أي إنك إذا شاركت محادثة ثم أرسلت رسالة وتلقيت رد لن يتم تضمينه في الرابط الذي تمت مشاركته.

لكن كل رسائلك السابقة واسمك وصورتك وردود ChatGPT في المحادثة حتى مشاركتها ستبقى في المشاركة.

الروابط التي تتم مشاركتها على هذا النمط, chatgpt.com/share ثم ID للمحادثة.

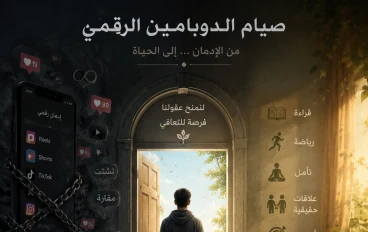

الهدف من المشاركة قد يكون إرسال المحادثة لشخص تعمل معه, او لصديق, أو ربما محادثة طريفة تود مشاركتها علنًا, لكن بالطبع لا يجب مشاركة المحادثات الخاصة.

توفر OpenAI منذ وقت طويل خيار Make this chat discoverable في قائمة المشاركة على الموقع, عند تفعيله, يسمح لمحركات البحث مثل Google بقراءة وفهرسة المحادثة وأرشفتها, ثم يمكن للمستخدمين عند البحث عن معلومات مماثلة أن يتلقو معلومات من محادثتك أنت مع ChatGPT.

يبدو أن العبارة السابقة غير دقيقة, حسنًا, يمكن للمستخدمين قراءة محادثتك التي قمت بمشاركتها إذا قمت بتفعيل خيار جعلها قابلة للاكتشاف.

ليس قراءتها فقط, يمكنهم الضغط على زر متابعتها حيث يمكنهم إضافتها إلى سجل دردشاتهم ثم إرسال رسائل جديدة على نفس السياق.

الميزة متوفرة منذ وقت طويل, فما يحدث حاليا له أكثر من تفسير.

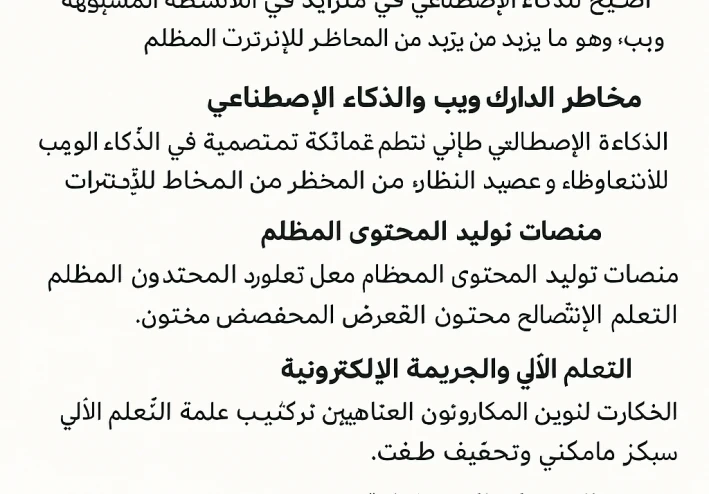

خلال آخر يومين, تداولت الكثير من المواقع التقنية العالمية أخبار حول العثور على محادثات خاصة في ChatGPT ضمن بحث Google.

وذكر موقع TechCrunch ما أسماه لمحة سريعة على العقل البشري, حيث يمكنك تصفية نتائج البحث في Google لتتضمن site:chatgpt.com/share ثم بين قوسين فصل العبارات المحتملة باستخدام or وستكتشف محادثات أشخاص غرباء مع ChatGPT.

حيث يمكنك قراءتها أو متابعتها إذا أردت.

تم طلب مجموعة من الاقتراحات لعمليات البحث التي قد تصل إلى نتائج خطيرة, قدم نموذج Claude عمليات بحث جاهزة يمكن تطبيقها لمحاولة العثور على محتوى خاص, وقام أحد المواقع بتجربتها وتحليل 512 محادثة.

تضمنت اعترافات بتفاصيل قانونية ومالية لشركات وعقود صفقات, اقتراحات من أطباء لتجربة أدوية غير مناسبة, التحايل على ChatGPT لجعله ينشئ صور مخالفة للقوانين, اعترافات بالتفكير في القتل وغير ذلك.

إلى جانب محاولات عملية غير مناسبة مثل طلب أحد الأشخاص إعادة كتابة ملف CV لقبوله في وظيفة, وأشار إلى عدم قبوله.

تحقق نفس المصدر من بعض المعلومات مثل الشركات والتفاصيل المالية ووجدها صحيحة.

مصادر إضافية لتدريب OpenAI على البيانات.